Es besteht sicherlich kein Zweifel daran, dass die ultimative Zukunft der KI darin besteht, die menschliche Intelligenz zu erreichen und zu übertreffen. Aber das ist eine weit hergeholte Leistung, die es zu erreichen gilt. Selbst die Optimistischsten unter uns setzen darauf, dass KI auf menschlicher Ebene (AGI oder ASI) in 10-15 Jahren verfügbar sein wird, und Skeptiker sind sogar bereit zu wetten, dass es Jahrhunderte dauern wird, wenn überhaupt möglich. Nun, darum geht es in dem Beitrag nicht (das solltest du lieber lesen Post wenn Sie daran interessiert sind, etwas über Superintelligenz zu lernen). Hier werden wir über eine greifbarere, nähere Zukunft sprechen und über die neuen und potenten KI-Algorithmen und -Techniken diskutieren, die unserer Meinung nach die nahe Zukunft der KI prägen werden.

KI hat begonnen, Menschen bei einigen ausgewählten und spezifischen Aufgaben zu verbessern. Zum Beispiel Prügelnde Ärzte bei der Diagnose von Hautkrebs und Sieg über Go-Spieler bei der Weltmeisterschaft. Dieselben Systeme und Modelle werden jedoch die Aufgaben nicht ausführen können, die sich von denen unterscheiden, für deren Lösung sie trainiert wurden. Aus diesem Grund wird auf lange Sicht ein allgemein intelligentes System, das eine Reihe von Aufgaben effizient erledigt, ohne dass eine Neubewertung erforderlich ist, als Zukunft der KI bezeichnet. Aber wie werden Wissenschaftler in naher Zukunft der KI, lange bevor die AGI veröffentlicht wird, dazu bringen, KI-gestützte Algorithmen dazu zu bringen, die Probleme, mit denen sie heute konfrontiert sind, zu bewältigen, damit sie aus den Laboren kommen und zu Objekten des täglichen Gebrauchs werden?

Wenn Sie sich umschauen, gewinnt die KI ein Schloss nach dem anderen (lesen Sie unsere Beiträge darüber, wie KI Menschen übertrifft, Teil eins und Teil zwei). Was könnte bei einem solchen Win-Win-Spiel möglicherweise schief gehen? Die Menschen produzieren mit der Zeit immer mehr Daten (das ist das Futter, das die KI verbraucht), und auch unsere Hardwarefähigkeiten werden besser. Schließlich sind Daten und bessere Berechnungen die Gründe, warum die Deep-Learning-Revolution 2012 begann, oder? Die Wahrheit ist, dass die menschlichen Erwartungen schneller wachsen als das Wachstum von Daten und Berechnungen. Datenwissenschaftler müssten über Lösungen nachdenken, die über das hinausgehen, was derzeit existiert, um reale Probleme zu lösen. Zum Beispiel ist die Bildklassifizierung, wie die meisten Menschen denken würden, wissenschaftlich gesehen eine Problem gelöst (wenn wir dem Drang widerstehen, 100% Genauigkeit oder GTFO zu sagen). Mithilfe von KI können wir Bilder klassifizieren (sagen wir in Katzen- oder Hundebilder), die den menschlichen Fähigkeiten entsprechen. Aber kann das schon für reale Anwendungsfälle genutzt werden? Kann KI eine Lösung für praktischere Probleme bieten, mit denen Menschen konfrontiert sind? In einigen Fällen ja, aber in vielen Fällen sind wir noch nicht da.

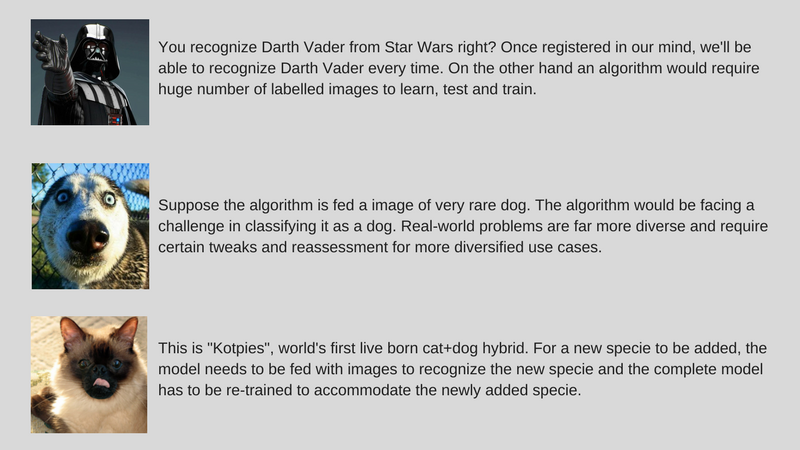

Wir werden Sie durch die Herausforderungen führen, die die Haupthindernisse für die Entwicklung einer realen Lösung mithilfe von KI darstellen. Nehmen wir an, Sie möchten Bilder von Katzen und Hunden klassifizieren. Wir werden dieses Beispiel im gesamten Beitrag verwenden.

Die folgende Grafik fasst die Herausforderungen zusammen:

Lassen Sie uns diese Herausforderungen im Detail besprechen:

Lernen mit weniger Daten:

- Für die Trainingsdaten, die die erfolgreichsten Deep-Learning-Algorithmen verwenden, müssen sie entsprechend dem Inhalt/der darin enthaltenen Funktion gekennzeichnet werden. Dieser Vorgang wird als Annotation bezeichnet.

- Die Algorithmen können die natürlich gefundenen Daten um Sie herum nicht verwenden. Ein paar hundert (oder ein paar tausend Datenpunkte) zu annotieren ist einfach, aber unser Algorithmus zur Bildklassifizierung auf menschlicher Ebene hat eine Million kommentierte Bilder aufgenommen, um gut zu lernen.

- Die Frage ist also, ob das Kommentieren von Millionen Bildern möglich ist? Wenn nicht, wie kann KI dann mit einer geringeren Menge an annotierten Daten skalieren?

Lösung verschiedener Probleme aus der realen Welt:

- Die Datensätze sind zwar fest, aber die Verwendung in der realen Welt ist vielfältiger (sagen wir zum Beispiel, ein Algorithmus, der auf farbigen Bildern trainiert wurde, kann bei Graustufenbildern im Gegensatz zu Menschen schwer versagen).

- Wir haben zwar die Computer-Vision-Algorithmen verbessert, um Objekte zu erkennen, die Menschen entsprechen. Aber wie bereits erwähnt, lösen diese Algorithmen ein sehr spezifisches Problem im Vergleich zur menschlichen Intelligenz, die in vielerlei Hinsicht viel allgemeiner ist.

- Unser Beispiel für einen KI-Algorithmus, der Katzen und Hunde klassifiziert, wird eine seltene Hundeart nicht identifizieren können, wenn er nicht mit Bildern dieser Art gefüttert wird.

Anpassung der inkrementellen Daten:

- Eine weitere große Herausforderung sind inkrementelle Daten. Wenn wir in unserem Beispiel versuchen, Katzen und Hunde zu erkennen, könnten wir unsere KI beim ersten Einsatz für eine Reihe von Katzen- und Hundebildern verschiedener Spezies trainieren. Aber bei der Entdeckung einer ganz neuen Spezies müssen wir den Algorithmus so trainieren, dass er „Kotpies“ zusammen mit der vorherigen Spezies erkennt.

- Obwohl die neuen Arten anderen Arten möglicherweise ähnlicher sind, als wir denken, und sie können leicht trainiert werden, um den Algorithmus anzupassen, aber es gibt Punkte, an denen dies schwieriger ist und ein vollständiges erneutes Training und eine Neubewertung erfordert.

- Die Frage ist, können wir die KI zumindest an diese kleinen Änderungen anpassbar machen?

Um KI sofort nutzbar zu machen, besteht die Idee darin, die oben genannten Herausforderungen durch eine Reihe von Ansätzen zu lösen, die als Effektives Lernen bezeichnet werden (bitte beachten Sie, dass dies kein offizieller Begriff ist, ich denke ihn mir nur aus, um nicht jedes Mal Meta-Learning, Transfer Learning, Few Shot Learning, Adversarial Learning und Multi-Task Learning zu schreiben). Wir, bei Parallele Punkte, nutzen diese Ansätze nun, um enge Probleme mit KI zu lösen. Sie gewinnen kleine Schlachten und bereiten sich gleichzeitig auf eine umfassendere KI vor, um größere Kriege zu besiegen. Lassen Sie uns Ihnen diese Techniken nacheinander vorstellen.

Bemerkenswert ist, dass die meisten dieser Techniken des effektiven Lernens nichts Neues sind. Sie erleben gerade ein Wiederaufleben. SVM-Forscher (Support Vector Machines) verwenden diese Techniken seit langem. Adversarial Learning hingegen ist etwas, das daraus entstanden ist Goodfellows jüngste Arbeit im Bereich GANs und Neural Reasoning ist eine neue Reihe von Techniken, für die seit Kurzem Datensätze verfügbar sind. Lassen Sie uns eingehend untersuchen, wie diese Techniken dazu beitragen werden, die Zukunft der KI zu gestalten.

Techniken zur Revolutionierung der nahen Zukunft der KI

Transferlernen

Was ist das?

Wie der Name schon sagt, wird das Lernen innerhalb desselben Algorithmus beim Transfer Learning von einer Aufgabe zur anderen übertragen. Algorithmen, die an einer Aufgabe (Quellaufgabe) mit größerem Datensatz trainiert wurden, können mit oder ohne Änderung übertragen werden. Dies ist Teil eines Algorithmus, der versucht, eine andere Aufgabe (Zielaufgabe) auf einem (relativ) kleineren Datensatz zu lernen.

Einige Beispiele

Die Verwendung von Parametern eines Bildklassifizierungsalgorithmus als Merkmalsextraktor bei verschiedenen Aufgaben wie der Objekterkennung ist eine einfache Anwendung von Transfer Learning. Im Gegensatz dazu kann es auch zur Ausführung zu komplexer Aufgaben verwendet werden. Das Algorithmus Google wurde entwickelt, um die diabetische Retinopathie besser zu klassifizieren als Ärzte, vor einiger Zeit wurde sie mit Transfer Learning erstellt. Überraschenderweise war der Detektor für diabetische Retinopathie tatsächlich ein Bildklassifikator aus der realen Welt (Bildklassifikator für Hunde und Katzen). Transfer Learning zur Klassifizierung von Augenscans.

Erzähl mir mehr!

In der Deep-Learning-Literatur finden Sie Datenwissenschaftler, die solche übertragenen Teile neuronaler Netze von der Quelle zur Zielaufgabe als vortrainierte Netzwerke bezeichnen. Bei der Feinabstimmung werden Fehler der Zielaufgabe leicht in das vortrainierte Netz zurückpropagiert, anstatt das vortrainierte Netzwerk unverändert zu verwenden. Eine gute technische Einführung in das Thema Transfer Learning in Computer Vision findet sich hier. Dieses einfache Konzept des Transferlernens ist in unseren Methoden für effektives Lernen sehr wichtig.

Multitasking-Lernen

Was ist das?

Beim Multi-Task-Lernen werden mehrere Lernaufgaben gleichzeitig gelöst, wobei Gemeinsamkeiten und Unterschiede zwischen den Aufgaben ausgenutzt werden. Es ist überraschend, aber manchmal kann das gemeinsame Lernen von zwei oder mehr Aufgaben (auch Hauptaufgabe und Nebenaufgabe genannt) zu besseren Ergebnissen für die Aufgaben führen. Bitte beachte, dass nicht jedes Paar, Triolett oder Quartett von Aufgaben als Hilfsaufgaben betrachtet werden kann. Aber wenn es funktioniert, ist es eine kostenlose Erhöhung der Genauigkeit.

Einige Beispiele

Bei ParallelDots wurden beispielsweise unsere Klassifikatoren Sentiment, Absicht und Emotionserkennung als Multi-Task-Learning trainiert, wodurch ihre Genauigkeit im Vergleich zu einem separaten Training erhöht wurde. Das beste semantische Rollenlabel und POS-Tagging System Wir wissen, dass es sich bei NLP um ein Multi-Task-Lernsystem handelt, also eines der besten Systeme für Semantik- und Instanzsegmentierung in Computer Vision. Google hat es sich ausgedacht multimodale Multitasking-Lernende (Ein Modell, das sie alle beherrscht), das in derselben Aufnahme sowohl aus Seh- als auch aus Textdatensätzen lernen kann.

Erzähl mir mehr!

Ein sehr wichtiger Aspekt des Multitask-Lernens, der sich in realen Anwendungen zeigt, ist das Training einer Aufgabe, damit sie kugelsicher wird. Dabei müssen wir viele Bereiche berücksichtigen, aus denen Daten stammen (auch Domänenanpassung genannt). Ein Beispiel für unsere Anwendungsfälle mit Katzen und Hunden ist ein Algorithmus, der Bilder aus verschiedenen Quellen (z. B. VGA-Kameras und HD-Kameras oder sogar Infrarotkameras) erkennen kann. In solchen Fällen kann jeder Aufgabe ein zusätzlicher Verlust der Domänenklassifizierung (woher die Bilder stammen) hinzugefügt werden, und dann lernt die Maschine, sodass der Algorithmus bei der Hauptaufgabe (Klassifizierung von Bildern in Katzen- oder Hundebilder) immer besser wird, bei der Hilfsaufgabe jedoch absichtlich schlechter wird (dies wird erreicht, indem der umgekehrte Fehlergradienten von der Domänenklassifizierungsaufgabe zurückpropagiert wird). Die Idee ist, dass der Algorithmus Unterscheidungsmerkmale für die Hauptaufgabe lernt, aber Merkmale vergisst, die Domänen unterscheiden, und das würde ihn besser machen. Multitask-Lernen und seine Verwandten aus der Domänenadaption sind eine der erfolgreichsten Techniken für effektives Lernen, die wir kennen, und sie spielen eine große Rolle bei der Gestaltung der Zukunft der KI.

Widersprüchliches Lernen

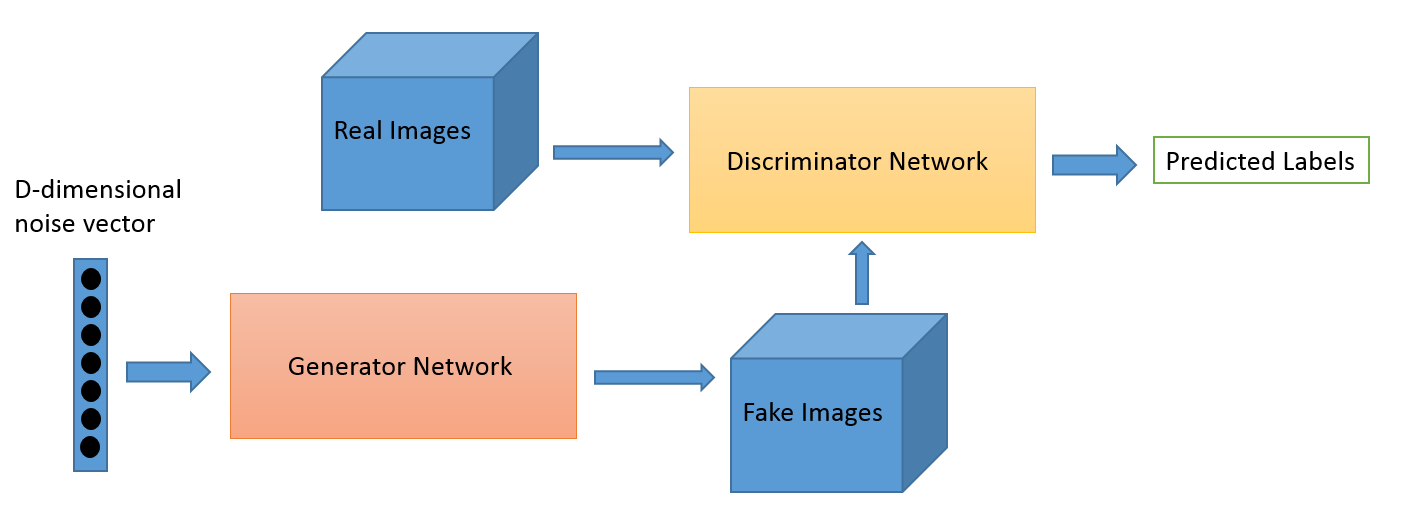

Was ist das?

Adversarial Learning als Feld ist aus der Forschungsarbeit von Ian Goodfellow hervorgegangen. Die beliebteste Anwendung von Adversarial Learning sind zweifellos Generative Adversarial Networks (GANs), die verwendet werden können, um atemberaubende Bilder zu erzeugen, aber es gibt noch viele andere Möglichkeiten für diese Techniken. Typischerweise hat diese von der Spieltheorie inspirierte Technik zwei Algorithmen, einen Generator und einen Discriminator, deren Ziel es ist, sich gegenseitig beim Training zu täuschen. Der Generator kann verwendet werden, um neue, neuartige Bilder zu generieren, er kann aber auch Repräsentationen beliebiger anderer Daten generieren, um Details vor Diskriminatoren zu verbergen. Aus letzterem Grund ist dieses Konzept für uns von so großem Interesse.

Einige Beispiele

Dies ist ein neues Feld und die Kapazität zur Bilderzeugung ist wahrscheinlich das, was die meisten Interessierten mögen. Astronomen konzentrieren Sie sich auf. Wir glauben jedoch, dass sich dadurch auch neuere Anwendungsfälle entwickeln werden, wie wir später erläutern.

Erzähl mir mehr!

Das Domainanpassungsspiel kann mithilfe des GAN-Verlusts verbessert werden. Der zusätzliche Verlust ist hier ein GAN-System anstelle einer reinen Domänenklassifizierung, bei dem ein Diskriminator versucht zu klassifizieren, aus welcher Domäne die Daten stammen, und eine Generatorkomponente versucht, dies zu täuschen, indem zufälliges Rauschen als Daten dargestellt wird. Unserer Erfahrung nach funktioniert das besser als eine einfache Domänenanpassung (die auch beim Code unberechenbarer ist).

Wenige Schnappschüsse lernen

Was ist das?

Few Shot Learning ist eine Studie über Techniken, die Deep-Learning-Algorithmen (oder andere Algorithmen für maschinelles Lernen) dazu bringen, mit weniger Beispielen zu lernen, als dies bei herkömmlichen Algorithmen der Fall wäre. One Shot Learning ist im Grunde genommen Lernen mit einem Beispiel für eine Kategorie, induktives K-Shot-Lernen bedeutet Lernen mit k Beispielen aus jeder Kategorie.

Ein paar Beispiele?

Das Fachgebiet Few Shot Learning verzeichnet einen Zustrom von Beiträgen auf allen wichtigen Deep-Learning-Konferenzen, und jetzt gibt es spezifische Datensätze um Ergebnisse zu vergleichen, genau wie MNIST und CIFAR für normales maschinelles Lernen. One-Shot Learning findet eine Reihe von Anwendungen bei bestimmten Bildklassifizierungsaufgaben wie der Erkennung und Darstellung von Merkmalen.

Erzähl mir mehr!

Es gibt mehrere Methoden, die für Few Shot Learning verwendet werden, darunter Transfer Learning, Multi-Task-Lernen sowie Meta-Learning als gesamter oder Teil des Algorithmus. Es gibt auch andere Möglichkeiten, wie clevere Verlustfunktion, unter Verwendung dynamische Architekturen oder mit Optimierungs-Hacks. Zero Shot Learning, eine Klasse von Algorithmen, die behaupten, Antworten für Kategorien vorherzusagen, die der Algorithmus noch nicht einmal gesehen hat, sind im Grunde genommen Algorithmen, die mit einer neuen Art von Daten skalieren können.

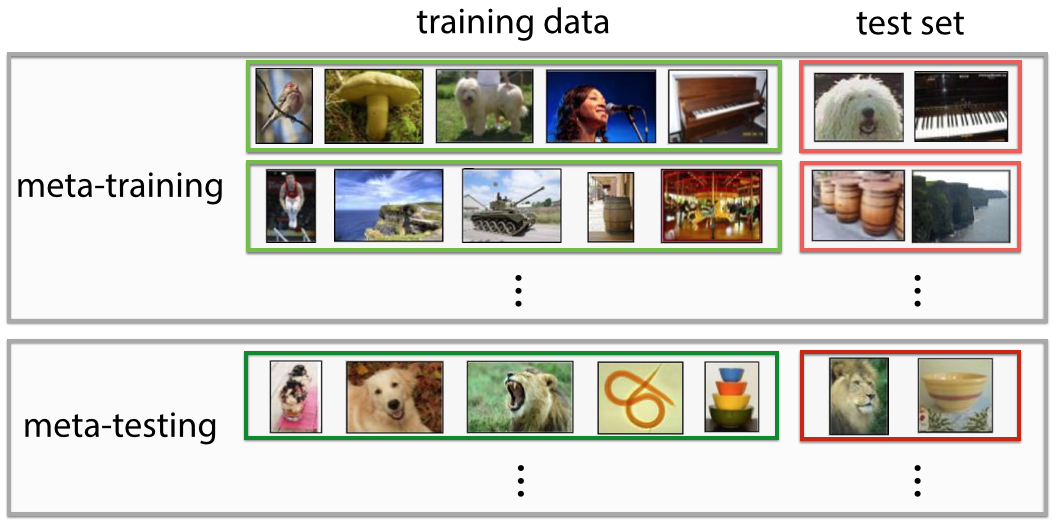

Meta-Lernen

Was ist das?

Meta-Learning ist genau das, wonach es sich anhört, ein Algorithmus, der so trainiert wird, dass er beim Betrachten eines Datensatzes einen neuen Prädiktor für maschinelles Lernen für diesen bestimmten Datensatz liefert. Die Definition ist sehr futuristisch, wenn man sie auf den ersten Blick betrachtet. Du fühlst dich „Whoa! Das macht ein Data Scientist „und er automatisiert den „sexiesten Job des 21. Jahrhunderts“, und in gewisser Hinsicht haben Meta-Learner damit begonnen (siehe Blogbeitrag von Google und das Forschungspapier).

Einige Beispiele

Meta-Learning ist in letzter Zeit zu einem heißen Thema im Deep Learning geworden. Viele Forschungsarbeiten wurden veröffentlicht, in denen am häufigsten die Technik zur Optimierung von Hyperparametern und neuronalen Netzwerken, zur Suche nach guten Netzwerkarchitekturen, zur Few-Shot-Bilderkennung und zum schnellen Reinforcement Learning verwendet wird. Einen umfassenderen Artikel zu Anwendungsfällen finden Sie hier.

Erzähl mir mehr!

Manche Leute bezeichnen diese vollständige Automatisierung der Festlegung von Parametern und Hyperparametern wie der Netzwerkarchitektur als AutoML, und Sie werden vielleicht Leute finden, die Meta Learning und AutoML als unterschiedliche Felder bezeichnen. Trotz des ganzen Hypes um sie herum ist die Wahrheit, dass Meta-Learner immer noch Algorithmen und Wege sind, um maschinelles Lernen zu skalieren, wenn die Komplexität und Vielfalt der Daten zunimmt.

Die meisten Meta-Learning-Papiere sind clevere Hacks, die laut Wikipedia folgende Eigenschaften haben:

- Das System muss ein Lernsubsystem enthalten, das sich an die Erfahrung anpasst.

- Erfahrungen werden gesammelt, indem Meta-Wissen genutzt wird, das entweder in einer früheren Lernphase anhand eines einzelnen Datensatzes oder aus verschiedenen Bereichen oder Problemen gewonnen wurde.

- Der Lernbias muss dynamisch gewählt werden.

Das Subsystem ist im Grunde ein Setup, das sich anpasst, wenn Metadaten einer Domain (oder einer völlig neuen Domain) eingeführt werden. Diese Metadaten können Aufschluss über die zunehmende Anzahl von Klassen, Komplexität, Veränderungen von Farben und Texturen und Objekten (in Bildern), Stilen, Sprachmustern (natürliche Sprache) und andere ähnliche Merkmale geben. Schau dir hier ein paar supercoole Artikel an: Geteilte Hierarchien beim Meta-Lernen und Meta-Lernen mit temporalen Windungen. Sie können Few Shot- oder Zero Shot-Algorithmen auch mithilfe von Meta-Learning-Architekturen erstellen. Meta-Learning ist eine der vielversprechendsten Techniken, die dazu beitragen werden, die Zukunft der KI zu gestalten.

Neuronales Denken

Was ist es?

Neural Reasoning ist das nächste große Ding bei Problemen mit der Bildklassifizierung. Neuronales Denken geht über die Mustererkennung hinaus. Algorithmen gehen über die Idee hinaus, Text oder Bilder einfach zu identifizieren und zu klassifizieren. Neuronales Denken löst allgemeinere Fragen in der Textanalyse oder visuellen Analytik. Das Bild unten stellt beispielsweise eine Reihe von Fragen dar, die Neural Reasoning anhand eines Bildes beantworten kann.

Erzähl mir mehr!

Diese neuen Techniken werden nach der Veröffentlichung des BaBi-Datensatzes von Facebook oder dem aktuellen CLEVR-Datensatz . Die Techniken zur Entschlüsselung von Beziehungen und nicht nur Mustern haben ein immenses Potenzial, um nicht nur neuronales Denken, sondern auch viele andere schwierige Probleme zu lösen, einschließlich Few-Shot-Lernproblemen.

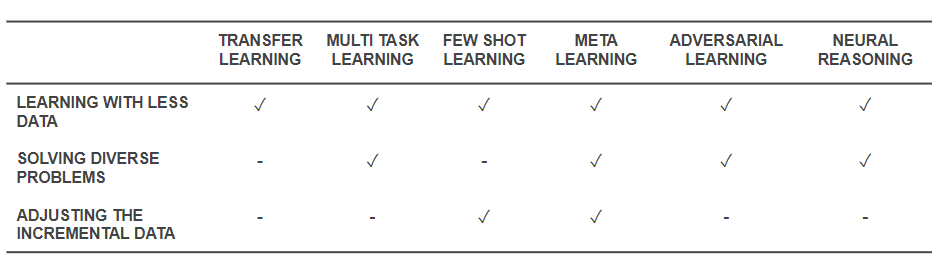

Jetzt, da wir wissen, was die Techniken sind, wollen wir zurückgehen und sehen, wie sie die grundlegenden Probleme lösen, mit denen wir begonnen haben. Die folgende Tabelle gibt einen Überblick über die Möglichkeiten effektiver Lerntechniken zur Bewältigung der Herausforderungen:

- Alle oben genannten Techniken helfen dabei, das Training auf die eine oder andere Weise mit einer geringeren Datenmenge zu lösen. Während Meta-Learning Architekturen liefern würde, die sich einfach an Daten anpassen würden, macht Transfer Learning Wissen aus einem anderen Bereich nutzbar, um weniger Daten auszugleichen. Few Shot Learning widmet sich dem Problem als wissenschaftliche Disziplin. Adversarial Learning kann helfen, die Datensätze zu verbessern.

- Domänenadaption (eine Art von Multi-Task-Lernen), kontradiktorisches Lernen und (manchmal) Meta-Learning-Architekturen helfen bei der Lösung von Problemen, die sich aus der Datenvielfalt ergeben.

- Meta-Learning und Few Shot Learning helfen bei der Lösung von Problemen mit inkrementellen Daten.

- Algorithmen für neuronales Denken haben ein immenses Potenzial zur Lösung realer Probleme, wenn sie als Meta-Learner oder Few Shot Learner eingesetzt werden.

Bitte beachten Sie, dass es sich bei diesen Techniken für effektives Lernen nicht um neue Deep-Learning-/Machine-Learning-Techniken handelt, sondern um eine Erweiterung der vorhandenen Techniken als Hacks, sodass sie für das Geld günstiger sind. Daher werden Sie unsere regulären Tools wie Convolutional Neural Networks und LSTMs weiterhin in Aktion sehen, allerdings mit den zusätzlichen Gewürzen. Diese effektiven Lerntechniken, die mit weniger Daten arbeiten und viele Aufgaben gleichzeitig erledigen, können dazu beitragen, die Produktion und Vermarktung von KI-gestützten Produkten und Dienstleistungen zu vereinfachen. Wir bei ParallelDots erkennen das Potenzial von effizientem Lernen an und machen es zu einem der Hauptmerkmale unserer Forschungsphilosophie.

.png)

%20(1).png)

.jpg)