Die Web 2.0-Revolution hat zu einer explosionsartigen Zunahme von Inhalten geführt, die täglich im Internet generiert werden. Social-Sharing-Plattformen wie Facebook, Twitter, Instagram usw. verzeichneten ein erstaunliches Wachstum ihrer täglich aktiven Nutzer, waren jedoch gespalten, wenn es darum geht, die von ihren Nutzern generierten Inhalte zu überwachen. Benutzer laden unangemessene Inhalte wie Nacktheit hoch oder verwenden beim Kommentieren von Beiträgen eine beleidigende Sprache. Ein solches Verhalten führt zu sozialen Problemen wie Mobbing und Rachepornos und beeinträchtigt auch die Authentizität der Plattform. Das Tempo, mit dem die Inhalte heute online generiert werden, ist jedoch so hoch, dass es fast unmöglich ist, alles manuell zu überwachen. Auf Facebook selbst werden insgesamt 136.000 Fotos hochgeladen, 510.000 Kommentare veröffentlicht und 293.000 Status werden alle 60 Sekunden aktualisiert. Bei ParallelDots haben wir dieses Problem durch maschinelles Lernen gelöst, indem wir einen Algorithmus entwickelt haben, der Nacktfotos (Nacktheitserkennung) oder missbräuchliche Inhalte mit sehr hoher Genauigkeit klassifizieren kann.

In einem unserer vorheriger Blog, wir haben besprochen, wie unsere Textanalyse-APIs Spam- und Bot-Konten auf Twitter identifizieren und verhindern können, dass sie die Twitter-Analyse verzerren. Wir haben ein weiteres wichtiges Tool für die Moderation von Inhalten hinzugefügt und zwei neue APIs veröffentlicht — die Nudity Detection API und die Abusive Content Classifier API.

Klassifikator zur Erkennung von Nacktheit

Datensatz: Nackt- und Nicht-Nacktfotos wurden von verschiedenen Internetseiten gecrawlt, um den Datensatz zu erstellen. Wir haben rund 200.000 Nacktbilder aus verschiedenen Foren und Websites für Nacktbilder gecrawlt, während Bilder von Menschen, die nicht nackt sind, von Wikipedia bezogen wurden. Dadurch konnten wir einen riesigen Datensatz erstellen, um den Klassifikator zur Erkennung von Nacktheit zu trainieren.

Architektur: Wir haben die ResNet50-Architektur für den Klassifikator gewählt, der vorgeschlagen wurde von Kaiming He u.a. im Jahr 2016. Der aus dem Internet gecrawlte Datensatz wurde nach dem Zufallsprinzip in einen Zug [80%], eine Validierung [10%] und einen Testsatz [10%] aufgeteilt. Die Genauigkeit des am Zugsatz trainierten Klassifikators und der auf dem Validierungssatz abgestimmten Hyperparameter liegen offenbar bei etwas über 95%.

Klassifikator für missbräuchliche Inhalte

Datensatz: Ähnlich wie beim Nudity Detection Classifier wurde der Datensatz des Missbrauchsklassifizierers erstellt, indem missbräuchliche Inhalte aus dem Internet, insbesondere Twitter, gesammelt wurden. Wir haben bestimmte Hashtags identifiziert, die mit missbräuchlicher und anstößiger Sprache in Verbindung stehen, und andere Hashtags, die mit nicht missbräuchlichen Sprachen in Verbindung stehen. Diese Tweets wurden weiter manuell überprüft, um sicherzustellen, dass sie korrekt klassifiziert wurden.

Architektur: Wir haben Long Short-Term Memory (LSTM) -Netzwerke verwendet, um den Missbrauchsklassifikator zu trainieren. LSTMs modellieren Sätze als eine Kette von Entscheidungen zwischen Vergessen und Erinnern, die auf dem Kontext basieren. Indem wir es anhand von Twitter-Daten trainiert haben, haben wir es in die Lage versetzt verstehe die vagen und schlecht geschriebenen Tweets voller Smileys und Rechtschreibfehler und trotzdem in der Lage sein, die Semantik des Inhalts zu verstehen und ihn als missbräuchlich einzustufen.

Den Klassifikator zum Laufen bringen: Anwendungsfall für die Inhaltsmoderation

Klassifizierer für missbräuchliche Inhalte und Nacktheitserkennung sind leistungsstarke Tools, um solche Inhalte aus Social-Media-Feeds, Foren, Messaging-Apps usw. herauszufiltern. Hier besprechen wir einige Anwendungsfälle, in denen diese Klassifikatoren zum Einsatz kommen können.

Feeds mit nutzergenerierten Inhalten

Wenn Sie eine mobile App oder eine Website besitzen, auf der Nutzer aktiv Fotos oder Kommentare posten, fällt es Ihnen bereits schwer, den Feed frei von missbräuchlichen Inhalten oder Nacktbildern zu halten. Die derzeit bewährten Methoden, Ihre Nutzer diese Inhalte kennzeichnen zu lassen, ist eine unzuverlässige und zeitaufwändige Aufgabe und erfordert ein Team von menschlichen Moderatoren, die jeden der markierten Inhalte überprüfen und entsprechende Maßnahmen ergreifen. Durch den Einsatz der Klassifikatoren Missbrauch und Nacktheitserkennung in solchen Apps können Sie Ihre Reaktionszeit beim Umgang mit solchen Inhalten verbessern. Ein perfektes Szenario wäre ein Szenario, in dem das System den Inhalt als unangemessen kennzeichnet und einen der Moderatoren alarmiert, noch bevor er in den öffentlichen Feed gelangt. Wenn die Moderatorin feststellt, dass der Inhalt fälschlicherweise als Nackterkennung oder als missbräuchlich (falsch positiv) eingestuft wurde, kann sie die Veröffentlichung des Inhalts genehmigen. Ein solches maschinell erweitertes menschliches Moderationssystem kann sicherstellen, dass Ihre Feeds frei von unangemessenen Inhalten sind und Ihr Markenimage erhalten bleibt.

Moderation des Forums

Eine der größten Erfindungen des Internets war die Fähigkeit, Inhalte in Form von Meinungen, Kommentaren, Fragen und Antworten usw. in Foren dynamisch zu generieren. Ein Nachteil dabei ist jedoch, dass diese Foren oft voller Spam und missbräuchlicher Inhalte sind, was zu Problemen wie Mobbing führt. Solche Inhalte, die sich in vielen dieser Foren hinter der Mauer der Anonymität verstecken, können katastrophale Auswirkungen auf Jugendliche und Schüler haben, was oft zu Selbstmordtendenzen führt. Die Verwendung des Missbrauchsklassifizierers kann Ihnen als Forumsinhabern helfen, den Inhalt zu moderieren und möglicherweise Benutzer zu sperren, die Wiederholungstäter sind.

Moderation von Kommentaren

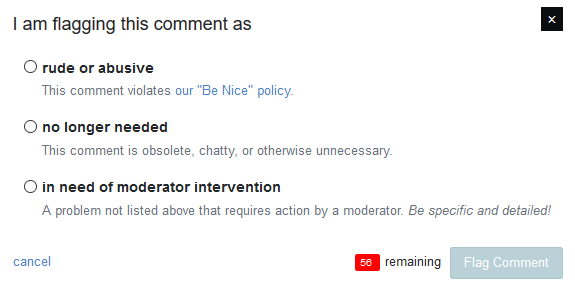

Ähnlich wie bei der Forenmoderation kann man den Missbrauchsklassifikator verwenden, um den Kommentarbereich des Blogs frei von missbräuchlichen Inhalten zu halten. Alle Nachrichtenmedien-Websites bemühen sich derzeit darum, ihre Inhalte sicher und missbrauchsfrei zu halten, da sie verschiedene kontroverse Themen wie Einwanderung, Terrorismus, Arbeitslosigkeit usw. behandeln. Den Kommentarbereich von missbräuchlichen oder anstößigen Inhalten fernzuhalten, hat heute für jeden Nachrichtenverlag oberste Priorität, und Missbrauchsklassifizierer können eine wichtige Rolle bei der Bekämpfung dieser Bedrohung spielen.

Digitale Marketingkampagnen mit Crowdsourcing

Digitale Marketingkampagnen, die auf Crowdsourcing-Inhalten basieren, haben sich als sehr effektive Strategie erwiesen, um die Konversation zwischen Marken und Verbrauchern anzukurbeln, wie Doritos Wettbewerb „Crash the Super Bowl“. Die von den Verbrauchern im Rahmen eines solchen Wettbewerbs hochgeladenen Inhalte müssen jedoch sorgfältig überwacht werden, um den Ruf der Marke zu schützen. Die manuelle Überprüfung jeder einzelnen Einreichung kann eine mühsame Aufgabe sein. Der Klassifikator zur Nackterkennung von ParallelDots kann verwendet werden, um nackte und missbräuchliche Inhalte automatisch zu kennzeichnen.

Filterung nackter Inhalte in digitalen Anzeigen

Werbebörsen haben mit der explosionsartigen Zunahme der Erstellung digitaler Inhalte an Beliebtheit gewonnen und sind nach wie vor die einzige Quelle der Monetarisierung für die meisten Blogs, Foren, mobilen Apps usw. Die Kehrseite davon ist jedoch, dass manchmal Anzeigen großer Marken auf Websites mit nackten Inhalten geschaltet werden können, was ihren Ruf schädigt. In einem solchen Fall wurden Anzeigen für Farmers Insurance auf einer Website namens DrunkenStepfather.com geschaltet, was hauptsächlich auf das Wachstum des Börsenkaufs von Anzeigen zurückzuführen ist. Der Slogan der Website lautet „Wir haben gerne Spaß mit hübschen Mädchen“ und eignet sich nicht für die Schaltung von Anzeigen von Farmers Insurance.

Anzeigenbörsen und Server können die Nudity Detection Classifier API von ParallelDots integrieren, um Herausgeber oder Werbetreibende von Nacktbildern zu identifizieren und die Anzeigenauslieferung einzuschränken, bevor es zu einer PR-Krise kommt.

Wie benutzt man den Nudity Detection Classifier?

Der Nudity Detection-Klassifikator von ParallelDots ist als API zur Integration in bestehende Anwendungen verfügbar. Die API akzeptiert einen Text oder ein Bild und kennzeichnet es in Echtzeit als missbräuchlichen bzw. nackten Inhalt. Probiere die API zur Erkennung von Nacktheit direkt im Browser aus, indem du hier ein Bild hochlädst. Schauen Sie sich auch die Demo zum Klassifikator für missbräuchliche Inhalte an, die hier verfügbar ist. Tauchen Sie ein in die API-Dokumentation für Nacktheitserkennung und Klassifizierung missbräuchlicher Inhalte oder schau dir das GitHub-Repo an, um loszulegen API-Wrapper in einer Sprache Ihrer Wahl.

Beide Klassifikatoren berechnen für ihre Vorhersage einen Konfidenzwert auf einer Skala von 0 bis 1. Ein Wert von 1 würde bedeuten, dass der Inhalt höchstwahrscheinlich missbräuchlich oder nackt mit einer sehr hohen Konfidenz ist, während ein Wert nahe 0 bedeuten würde, dass der Algorithmus seiner Vorhersage nicht sehr sicher ist.

.png)

%20(1).png)

.jpg)